警惕算法分发 便捷背后隐藏的互联网信息风险

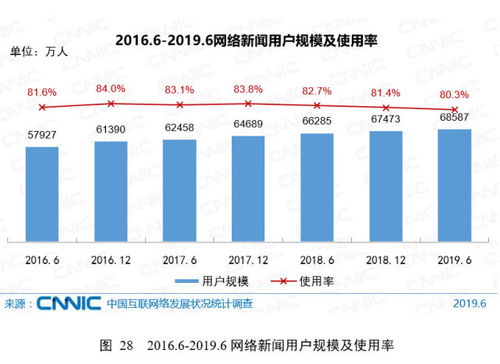

在当今数字时代,算法分发已成为互联网新闻信息服务的主流模式。它通过分析用户行为、偏好和社交关系,精准推送个性化内容,极大地提升了信息获取的效率和体验。从新闻资讯、短视频到社交媒体,算法无处不在,仿佛一位“智能管家”,为我们筛选着海量信息。在这份便捷与智能的背后,一系列潜在的风险与挑战正悄然滋生,亟待我们清醒认识和审慎应对。

一、信息茧房:认知的窄化与固化

算法最核心的风险在于其可能强化“信息茧房”效应。系统倾向于持续推荐用户感兴趣或认同的内容,长期沉浸其中,用户接触的信息面会变得越来越狭窄,如同作茧自缚。这不仅限制了人们对世界多元、复杂面貌的认知,还可能加剧观点和立场的极化。当不同群体沉浸在各自的信息孤岛中,彼此的理解与对话将变得愈发困难,社会共识的构建面临挑战。

二、内容质量失衡:流量至上与价值失位

算法的优化目标往往是用户 engagement(参与度),如点击率、观看时长、转发评论等。这容易导致平台和内容创作者为了获取流量而迎合算法偏好,大量生产标题党、情绪化、低质甚至虚假的信息,因为这类内容通常更容易引发强烈反应。严肃、深度、需要理性思考的优质内容,反而可能在流量竞争中处于劣势,造成“劣币驱逐良币”的现象,侵蚀互联网信息生态的健康根基。

三、隐私安全与数据滥用

算法的精准运行高度依赖对用户数据的收集、分析和画像。这涉及深度的隐私采集,包括浏览历史、地理位置、社交关系乃至设备信息等。一旦数据保护不力或被不当滥用,用户不仅面临隐私泄露的风险,其个人信息还可能被用于精准的商业操纵、价格歧视,甚至在极端情况下影响社会舆论和个体决策,构成对个人自主性的隐形侵害。

四、价值观与意识形态的隐形塑造

算法并非完全中立的技术工具。其设计逻辑、权重设置、训练数据都蕴含着设计者和平台方的价值判断。通过决定“哪些信息被看见”、“以何种顺序和频率呈现”,算法在无形中塑造着用户关注的话题、看待问题的角度乃至价值观念。如果缺乏有效的监督与平衡,单一的商业逻辑或特定倾向可能通过算法被无限放大,对公共议程和社会文化产生深远影响。

五、主体责任模糊与监管挑战

在算法分发的模式下,传统“编辑”的把关责任在一定程度上转移给了自动化系统。当出现低俗、虚假、侵权或有害信息时,平台常以“技术中立”或“仅提供分发服务”为由规避责任。算法的“黑箱”特性也使得其决策过程不透明、难解释,给监管和问责带来了巨大技术难度与法律挑战。如何界定平台在算法推荐中的主体责任,成为全球性的治理难题。

应对与展望:走向负责任的算法时代

面对这些风险,我们并非无能为力。迈向更健康的信息生态,需要多方协同努力:

- 平台责任强化:互联网企业应提升算法透明度,建立人工干预和纠偏机制,优化算法价值导向,平衡商业目标与社会责任,优先推荐优质、可信、多元的内容。

- 监管法规完善:政府需建立健全适应算法时代的法律法规,如明确算法备案、透明性要求、主体责任,并对数据收集使用划定更清晰的红线。

- 用户素养提升:作为个体,我们应培养自身的媒介素养和信息鉴别能力,主动“破圈”,有意识地接触不同来源、不同观点的信息,保持开放和批判性思维。

- 技术创新向善:鼓励开发更注重内容质量、多样性、公共价值的算法模型,探索“人机协同”的审核与推荐模式。

算法分发是技术进步赐予我们的利器,但它绝非没有代价的礼物。唯有清醒认识其双刃剑本质,通过有效的治理、企业的自律与公众的自觉,才能驾驭好这股强大的技术力量,使其真正服务于信息传播的丰富、多元与真实,赋能一个更加清朗、理性、包容的数字公共空间。

如若转载,请注明出处:http://www.seatuneagent.com/product/67.html

更新时间:2026-05-02 17:35:44